Dziś na warsztat wjeżdża (trochę przypadkowo) temat z zakresu optymalizacji modeli językowych. Czyli krótka notatka z podsumowaniem badania Understanding Warmup-Stable-Decay Learning Rates: A River Valley Loss Landscape Perspective (link poniżej).

Przypadkiem bo poszukiwałem badań na temat optymalizatorów gradientu i klucz poszukiwań oparłem o obszar geograficzny, zakładając, że może coś ciekawego odkryję w domenach bliżej powiązanych z geografią czy geodezją… i zupełnie przypadkiem trafiłem na to badanie. Temat porusza ciekawy obszar strategii uczenia u budowania harmonogramu pracy ze wskaźnikiem uczenia dużych modeli (tutaj co prawda mówimy o kontekście LLM, ale nie zawężałbym tylko do tego “aktualnie modnego” obszaru.

Badanie jest dość skomplikowanie matematycznie i nie czuję potrzeby przepisywania go tutaj (link poniżej dla zainteresowanych), więc zostawiam w podsumowaniu kilka punktów w formie bookmarków, aby łatwiej to kiedyś znaleźć.

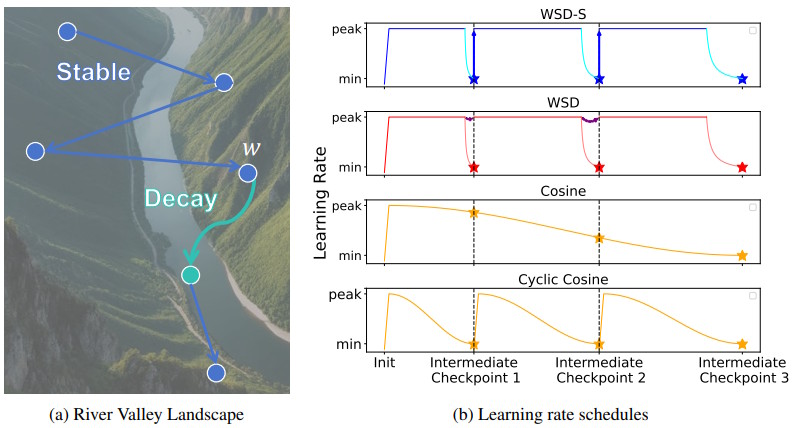

Standardem przemysłowym w trenowaniu modeli takich jak GPT czy LLaMA jest wykorzystanie harmonogramu współczynnika uczenia typu Cosine (Cosine Learning Rate Schedule). Harmonogram ten zakłada:

- Fazę rozgrzewki (warmup), w której współczynnik uczenia (learning rate – LR) rośnie liniowo.

- Fazę spadkową, w której LR maleje zgodnie z funkcją cosinus do wartości bliskiej zeru w dokładnie określonym kroku końcowym.

Główną wadą tego podejścia jest jego sztywność. Kształt krzywej cosinusowej jest deterministycznie zależny od całkowitej liczby kroków. Jeśli w trakcie treningu okaże się, że dysponujemy dodatkowym budżetem obliczeniowym lub nowymi danymi, nie możemy po prostu „przedłużyć” treningu. Krzywa LR dla dłuższego treningu miałaby zupełnie inny kształt od samego początku. Próby „odgrzewania” (rewarming) modelu poprzez ponowne zwiększenie LR często prowadzą do niestabilności lub nieodwracalnej degradacji wydajności, co wymusza kosztowne trenowanie od zera dla każdego nowego budżetu (zgodnie z prawami skalowania Hoffmanna).

W odpowiedzi na te ograniczenia, badacze zaproponowali harmonogram Warmup-Stable-Decay (WSD). Jego struktura jest fundamentalnie odmienna i składa się z trzech faz:

- Warmup: Krótka faza wzrostu LR.

- Stable (Faza Stabilna): Długa faza utrzymywania stałego, wysokiego współczynnika uczenia. Ta faza może trwać w zasadzie w nieskończoność, co uniezależnia proces od z góry narzuconego budżetu.

- Decay (Faza Zaniku): Krótka faza gwałtownego zmniejszania LR, uruchamiana w momencie, gdy decydujemy się zakończyć trening i uzyskać gotowy checkpoint.

Zanim przejdziemy do wyjaśnień teoretycznych, warto omówić samo zjawisko, które badacze zaobserwowali empirycznie, a które stanowi punkt wyjścia dla całej analizy. Podczas fazy stabilnej, w której utrzymywany jest stały, wysoki współczynnik uczenia, wartość funkcji straty pozostaje na poziomie znacznie wyższym niż w przypadku modeli trenowanych harmonogramem cosinusowym. W tradycyjnym ujęciu inżynierskim mogłoby to zostać zinterpretowane jako sygnał, że model “nie uczy się” optymalnie lub że współczynnik uczenia jest zbyt wysoki, uniemożliwiając zbieżność do minimum. Krzywa straty jest płaska lub opada bardzo powoli, sugerując stagnację. Kluczowy moment następuje, gdy rozpoczyna się faza zaniku (Decay). W momencie rozpoczęcia redukcji współczynnika uczenia, funkcja straty nie spada stopniowo – pojawia się zjawisko określane jako “pionowy spadek”. Błąd modelu gwałtownie maleje, w bardzo krótkim czasie przebijając poziomy osiągane przez harmonogram cosinusowy.

Aby wyjaśnić mechanikę WSD, autorzy odchodzą od klasycznego wyobrażenia funkcji straty jako prostej wypukłej miski. Zamiast tego proponują model topograficzny przypominający głęboki kanion z rzeką płynącą na jego dnie. Model ten jest sformalizowany matematycznie w sekcji 3 oraz w Dodatku A omawianego dokumentu.

Zrozumienie interakcji między algorytmem Stochastycznego Spadku Gradientu (SGD) a tym krajobrazem jest kluczem do wyjaśnienia paradoksu WSD. Autorzy przeprowadzają analizę w trzech etapach: dla przepływu gradientowego (ciągły czas), dla deterministycznego GD (dyskretny czas) i wreszcie dla SGD (dyskretny czas + szum).

Autorzy badania nie poprzestają na opisie geometrii, ale zadają głębsze pytanie: Dlaczego funkcja straty w modelowaniu języka ma kształt doliny rzecznej? Co w naturze danych tekstowych powoduje powstawanie tak ekstremalnych różnic w krzywiźnie (płaskie dno vs strome ściany)?

Badanie proponuje Uncertainty Variation Hypothesis (Hipotezę Zmienności Niepewności?). Opiera się ona na obserwacji, że tokeny w języku naturalnym mają fundamentalnie różną naturę statystyczną: tokeny deterministyczne (fakty i gramatyka) oraz tokeny stochastyczne (niejednoznaczność i styl)

W klasycznym podejściu WSD, aby kontynuować trening po uzyskaniu checkpointu (przejściu przez fazę decay), należało cofnąć się do stanu sprzed zaniku i kontynuować trening na głównej gałęzi ze stałym LR. Było to motywowane obawą, że mały LR w fazie decay “psuje” dynamikę treningu. Badanie obala tę obawę. Skoro w fazie decay model nadal porusza się wzdłuż rzeki (tylko z mniejszą oscylacją), to stan końcowy po fazie decay jest lepszym punktem startowym niż stan przed nią – jest dalej wzdłuż nurtu rzeki.

Reszta w badaniu

Linki i źródła

Raport z badania Understanding Warmup-Stable-Decay Learning Rates: A River Valley Loss Landscape Perspective https://arxiv.org/abs/2410.05192