Jakiś czas temu czytałem raport o podobnym tytule do tego artykułu. Przypomniał mi o nim kolega, gdy dyskutowaliśmy o opcjach wykorzystania RNN jako formy szkieletu dla pewnego rozwiązania w kontekście finansów. Odkopałem to badanie z 2023, którego oryginalny tytuł to: Gated recurrent neural networks discover attention. Dokument ten dotyka podstawowego problemu w dziedzinie przetwarzania sekwencji (NLP, analiza szeregów czasowych): czy dominacja architektury Transformer jest ostateczna, czy też klasyczne sieci rekurencyjne (RNN) mogą powrócić do łask, oferując te same możliwości przy znacznie niższym koszcie obliczeniowym. Nie będę tutaj zdradzał kontekstu naszej rozmowy, ale to badanie w tym kontekście wydaje się bardzo interesujące. Trochę jako bookmark wrzucę małe podsumowanie.

W prostych słowach, autorzy pracy dowodzą, że odpowiednio skonstruowana sieć rekurencyjna (RNN), wyposażona w mechanizm bramkowania (mnożenia sygnałów), jest matematycznie równoważna mechanizmowi uwagi (Attention), który stanowi serce modeli takich jak GPT/Bert. Wyniki badania stanowią teoretyczny fundament dla nowej fali modeli językowych, takich jak Mamba czy RWKV, oferując możliwość przetwarzania nieskończenie długich dokumentów bez zapchania pamięci.

Aby dobrze zrozumieć obszar badania, warto się spojrzeć szerzej z perspektywy historycznej.Od dekad badacze sztucznej inteligencji poszukują “świętego graala” przetwarzania sekwencji – architektury, która potrafi pamiętać odległe fakty (kontekst) równie dobrze jak człowiek, a jednocześnie przetwarzać dane z prędkością superkomputera. Przez lata standardem w branży były sieci rekurencyjne, w szczególności LSTM (Long Short-Term Memory) i GRU (Gated Recurrent Unit). Działały one na zasadzie sekwencyjnego przetwarzania: czytały słowo po słowie, aktualizując swój wewnętrzny “stan ukryty”. W 2017 roku architektura Transformer zmieniła wszystko. Wprowadziła mechanizm Self-Attention. Zamiast kompresować tekst do “stanu ukrytego”, Transformer w każdej chwili patrzy na całą historię tekstu naraz. Wyglądało jak poszukiwany graal… ale, koszt obliczeniowy w przypadku transferów rośnie kwadratowo dla długości kontekstu. Jeśli podwoimy długość tekstu, zapotrzebowanie na pamięć i moc rośnie czterokrotnie.

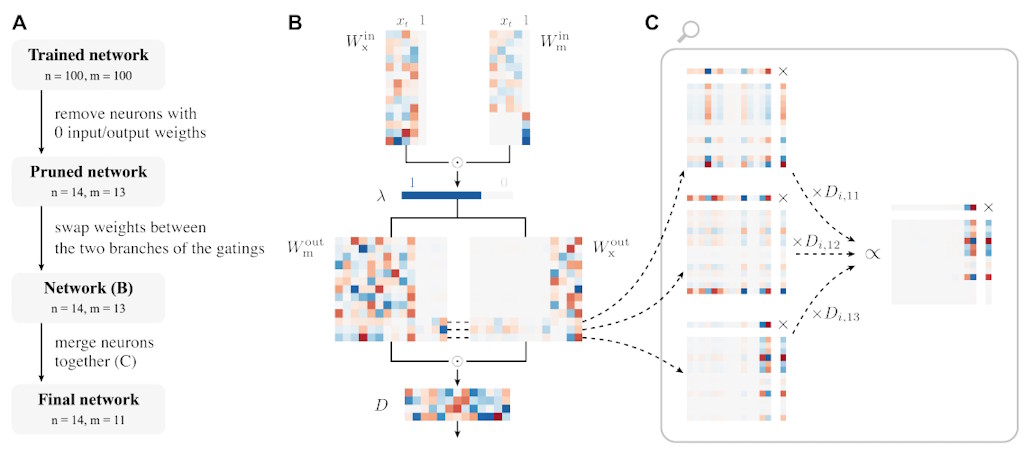

No i tutaj wracamy do badania – głównym wkładem merytorycznym pracy jest dowód, że prosta sieć RNN może dokładnie symulować mechanizm uwagi. Autorzy pracy dowodzą, że Linear Self-Attention (Liniowa Samoatencja – jakkolwiek zabawnie brzmi to po polsku), może być zaimplementowana przez RNN z wykorzystaniem:

- Input Gating – RNN używa bramki, która jest iloczynem dwóch liniowych projekcji wejścia. W tradycyjnych RNN bramki służyły tylko do “przepuszczania” lub “blokowania” sygnału. Tutaj służą do tworzenia bogatej reprezentacji asocjacyjnej.

- Rekurencji – stan ukryty działa jak sumator. Jak dobrze rozumiem to jest macierz “szybkich wag”, o której mówili twórcy Transformera.

- Output Gating – wyjście RNN jest mnożone przez kolejną bramkę. Ta operacja odpowiada mnożeniu zgromadzonej “wiedzy” przez bieżące bazowe/bieżące zapytanie.

Tyle na szybko. Reszta w raporcie.

Linki i źródła

- Raport z badania: „Gated recurrent neural networks discover attention” (Zucchet et al., 2023) – https://arxiv.org/abs/2309.01775